本文来自semiengineering。

随着高性能计算(HPC)与人工智能加速器将功率密度推高至1千瓦及以上,晶体管高速开关所产生的热量正变得越来越难以散发。

工程师们开始采用自适应网格有限元建模,以精确模拟热传导分布。而搭载加热器与温度传感器的有源测试晶圆等新型方法,则能打通仿真与实验环节,最终优化多芯粒封装的设计与使用寿命。

为了更好地“攻克散热难题”,多家机构正研究如何用真实实验数据验证仿真结果,典型案例包括:

AMD开发了封装级、软件可编程热评估平台,可在芯片研发同步开展热分布、导热界面材料(TIM)与散热需求评估;

Fraunhofer IIS/EAS研制出有源热测试晶圆,可直接测量温度分布,展示热量如何传播、在芯粒间耦合以及冷却时的耗散过程;

安靠(Amkor)展示了搭载加热裸片与传感器的产品原型如何验证仿真精度;

IMEC优化了HBM堆叠GPU架构,通过系统技术协同优化(STCO)将GPU峰值温度从140℃以上降至71℃以下。

从“次要问题”变为“核心优先级”

在单片芯片封装时代,工程师依靠公式,结合芯片与封装各部分的热阻近似估算器件结温。

安靠技术芯粒/FCBGA集成副总裁迈克・凯利表示:“热仿真对高功率器件向来至关重要,需确保工作时晶体管级最高结温Tj不超过推荐上限,例如CMOS器件为105℃,DRAM约为85℃。”

多年来,工程师一直依赖简化方法计算结温。“当单个IC封装内只有一颗硅裸片(如倒装BGA)时,确实有简便方法估算IC可承受的最大功率,同时让最高结温符合硅片厂商规范,”凯利说,“散热问题被拆解为基板、顶盖、裸片、底部填充胶等一系列热阻,传导与对流方程可联立求解。只要知道单颗裸片总功耗、所有热阻与环境温度,就能算出芯片结温。”

而在多裸片封装时代,热管理思路已完全改变。通过系统技术协同优化(STCO),热仿真在设计早期便介入,用于优化芯粒布局、最小化芯粒间热耦合、防止热失控(芯片升温→器件需更多功耗→进一步升温),并降低昂贵散热方案的依赖。

新思科技半导体事业部产品营销总监Marc Swinnen表示:“对于GPU、微处理器这类高端系统,我们已逼近现有技术极限。热仿真已大幅前移至原型设计阶段,与传统设计流程位置完全相反。如今,热设计已是多芯粒架构的核心环节。”

用AI定位热点

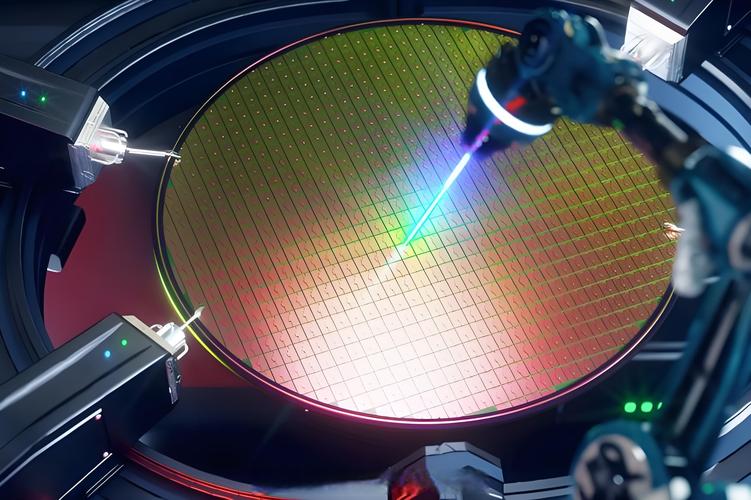

为将3D热仿真融入电子设计自动化(EDA)流程,工程师采用有限元法,将芯片与封装区域划分为不同大小的网格,再根据硅、介电材料、铜、底部填充胶等介质特性模拟热流。

“把结构拆成大量微小网格单元,对每个区域求解热方程,就能得到温度分布。难点在于网格划分,”Swinnen说,“网格生成后,套用热方程很简单,但构建网格需要在精度与速度间平衡。网格越密精度越高,但单元更多、计算更慢;网格稀疏速度更快,却无法捕捉细节。因此最优方案是自适应变网格。当然,这需要预先知道热点位置,而AI恰好能实现这一点——AI可预判热点分布,让网格划分更高效,大幅缩短热仿真时间。”

高温会从多方面损害器件性能与长期可靠性:

- 温度越高,芯片功耗越大,极端情况下会引发热失控;

- 热量会从一颗芯片传导至相邻芯片,将芯片级问题升级为系统级问题;

- 芯片温度过高可能导致焊料凸点熔化。

芯片发热量是动态的,会随负载变化。Swinnen指出:“原型阶段的早期热仿真至关重要,可避免先进封装中芯粒布局出现重大失误,防止设计返工或额外增加散热成本。关键不仅是平均温度,更在于峰值温度。”

AMD的Jae-Gyung Ahn解释道:“网格尺寸越小,热点越清晰、越集中。但过小网格捕捉到局部峰值温度后,若用热梯度(TG)代表整个IP模块温升,可能会过度悲观地评估热风险。从计算量看,200μm网格求解时间比1000μm网格高约1200%,500μm网格仅增加40%。因此必须结合热点位置与电迁移(EM)风险最坏情况,谨慎确定最优网格尺寸。”在此案例中,AMD建议在峰值功率密度区域采用20μm或100μm网格,平衡计算效率与精度。

Swinnen提出热仿真另一大挑战:“热仿真中常被忽视的因素是真实工作负载。芯片发热完全源于数据处理,活动越多功耗越高。问题在于热传导时间常数远慢于电学开关速度,这意味着需要极长的工作序列才能模拟热效应。例如,1GHz处理器1秒活动就需要10亿条行为向量,远超功能仿真或时序分析所用数量。获取如此长的真实芯片负载只能依靠硬件仿真器在寄存器传输级(RTL)长时间仿真,再将负载预处理、整合为热求解器可用的简化模式。”

行业长期使用被动测试结构验证建模结果,但这类方法难以适配AI加速器中存在的非均匀热负载与移动热点。

为此,Fraunhofer IIS自适应系统工程部开发了热测试平台,集成细粒度可编程加热单元与高分辨率传感结构。该部门高效电子部门主管Andy Heinig表示,这款实测热测试晶圆可揭示热量在不同材料间的传播与芯粒间耦合,帮助评估散热方案效果。

其可编程数字加热模块与温度传感器可静态、动态模拟真实芯粒负载。该方案以数字单元基本模块为可重构热源,通过调节模块数量、尺寸与布局实现不同功率密度,在晶圆上生成单点或多点细粒度热点,完成系统级热测量;随时间变化的开关模式可模拟热点移动,温度传感器则能高精度捕捉热梯度。

Heinig表示:“该架构支持细粒度可编程、模块化扩展与动态重构,晶圆不局限于单次实验,可广泛复用。研究人员能针对特定负载定制加热模式,调节热应力强度与范围,采集详细数据集用于模型校准与设计评估。该平台可复现供电网络、导热界面材料与异构芯片布局的综合效应,帮助研究人员确定可靠性极限与安全工作区间。”

热问题另一关键诱因是供电。AI加速器与高性能GPU的高电流密度会增大供电网络损耗,引发焦耳热。行业正通过多种方式应对,包括将供电网络移至晶圆背面,以及采用功耗感知与布局感知的平面规划以降低峰值功率密度。

背面供电网络、混合键合等新工艺解决了互联难题,却加剧了散热压力。凯利指出:“两颗或多颗硅裸片堆叠时,无论采用混合键合还是传统铜柱凸点,都必须在设计早期充分考虑相对裸片的总热量。这要求在功能模块平面规划阶段估算堆叠中所有裸片的结温,从而制定合理时钟策略、优化堆叠性能并满足结温限制。理想情况下,EDA工具可通过内置热仿真实现此类优化,或在平面规划迭代中使用专用热仿真软件。”

至关重要的是,即便最精准的仿真也需要真实实验验证。

封装级热测试平台贯穿产品全生命周期

多芯片系统热行为精准建模对产品全生命周期愈发重要。AMD技术骨干苏雷什・帕拉梅斯瓦兰在近期文章中表示:“从初始规划到客户板级部署,必须在整个开发周期评估并管理芯片热特性。”AMD团队为2D/3D封装开发了热评估平台,可在芯片研发阶段同步评估架构与平面规划、交叉验证3D仿真结果与芯片级测量数据,并提前评估导热界面材料、散热方式等封装方案。该团队强调,该热测试平台具备易实施、软件可编程、片上温度测量反馈快等优势。

当前主流方案结合有限元建模与产品原型。安靠的凯利介绍:“行业常用有限元软件仿真封装,或搭建‘加热裸片’产品复制品——这类特制硅裸片集成片上加热器,输入真实产品典型功耗。温度传感器通常集成在加热裸片内,输入功耗后可在不同位置测量结温。”

由于产品复制品成本高昂,通常仅制作一种封装配置用于验证有限元分析(FEA)精度,其余大量配置则直接通过软件估算。

工程师会结合散热方式进行有限元网格划分,综合考虑芯片发热、向相邻芯片与中介层的热传导,以及散热器、风扇、点式液冷或仍在研发的浸没式液冷等散热效果。

力学因素的介入

多裸片堆叠中,材料热膨胀系数(CTE)不匹配带来的机械应力往往极大,因此除热变化外,还必须建模力学变化。Swinnen表示:“热效应与力学效应的数学模型高度相似,我们在3D-IC分析工具中整合了两项能力。只要获得晶圆厂加密工艺文件中的材料属性,就能计算每一点的冯・米塞斯力,进而求得应力与翘曲变形。刚度更高的材料翘曲更小,但内应力更大;柔性材料应力更低,却变形更明显。”

GPU上方堆叠四颗HBM

IMEC团队的研究体现了跨层热协同设计的重要性。该团队通过STCO与工艺级缓解方案,将GPU上方四颗12层HBM堆叠3D架构的结温从140℃以上降至与2.5D架构相当的70.8℃。该GPU功耗414瓦,AI负载下每颗HBM功耗40瓦。

HBM沿GPU短边堆叠,通过微凸点连接信号层,GPU采用背面供电网络。研究人员首先移除四颗HBM堆叠中功能冗余的底层逻辑裸片,改善GPU与HBM间热耦合,DRAM间采用混合键合;顶盖侧通过微通道或喷射冲击冷却,散热系数30kW/m²K;层压底板侧风冷散热,系数200W/m²K,采用新思科技Icepak进行热特性分析。

随后,将相邻DRAM堆叠间的塑封料替换为热硅,提升纵向与横向散热;同时减薄顶部DRAM裸片以缩短垂直热路径,并在GPU热点处选择性放置热硅。STCO策略包括双面冷却与GPU核心频率减半,将峰值温度从120℃降至99℃;后续进一步调频并增加热硅用量,最终将GPU峰值温度降至71℃,与2.5D架构(69℃)基本持平。

IMEC团队表示:“研究结果不仅为严苛热约束管理提供思路,也证明STCO可显著提升未来3D GPU架构的热可行性与性能。”

结语

随着行业加速采用混合键合、背面供电网络、多裸片封装等先进工艺,将更依赖带自适应网格的热仿真软件,平衡计算时间与模型精度,并可同时建模相互耦合的热行为与力学行为。

集成加热与传感元件的实验复制品或原型,能为模型结果提供宝贵验证。通过热硅块辅助散热等系统协同设计方案,可在常规AI负载下显著降低HBM/GPU 3D堆叠的GPU峰值温度。