本文来自中国电子信息产业发展研究院,作者/赛迪译丛。

2021年11月,世界经济论坛发布了《人工智能治理之旅:发展与机遇》。为此报告提出若干政策建议,呼吁多利益攸关方采取“灵活治理”的方式,共同参与人工智能治理。赛迪智库政策法规研究所对该报告进行了编译,期望对我国有关部门有所帮助。

报告指出,人工智能技术取得飞速发展,但相关的治理能力和框架却没有及时跟进。近几年,各方对治理人工智能提出了很多伦理道德原则,但如何在不扼杀创新的前提下管控风险并推动人工智能治理由原则向实践转化才是最关键的。

一、背景

在过去五年,人工智能治理取得了迅猛发展,构建人工智能监管生态系统的速度大大提高,但如何以负责任的方式推动人工智能的应用和实践依旧是当前面临的迫切挑战。人工智能有独特的风险,简单照抄现有政策工具并不能处理好这些问题,社会必须考虑在应用人工智能时完善相关手段和措施,以此来化解先进决策系统带来的潜在风险。

二、人工智能发展历程回顾

历次工业革命既创造机遇,也带来挑战,迫使社会重新审视当时的治理结构能否有效维持监管与创新之间的平衡。人工智能是推动第四次工业革命的引擎,围绕人工智能及其安全防护措施将会出现诸多挑战。对其历史发展进程进行总结回顾十分重要,只有通过回顾过去,才能把握未来的发展方向。

(一)2010年以前:人工智能的冬天与解冻

早在人工智能发展初期,大家都认为人工智能发展到可以承担权责的程度时,就有必要认真考虑治理方面的问题。即使是处于历史学家认为的“人工智能冬天”(即人工智能及公众兴趣走低的时期),人们对人工智能带来的后果和治理效果也抱有担忧和恐慌。另外,人工智能的潜在应用范围极广、社会影响深远,这势必引发人们对隐私、安全、偏差、公正等议题的担忧。因此,在制定政策时必须从多领域的现有框架中汲取经验,包括国际法、公共政策、数据治理与伦理道德规范等领域。

(二)2010年到2016年:人工智能加速发展带来的挑战

2010年以后人工智能的发展开始提速,主要源于三方面的突破:一是计算能力提升,二是云计算渠道增加,三是数字化数据量激增。同时,人工智能在深度学习方面也取得了明显进展。

人工智能的快速发展及应用的确鼓舞人心,但同样也引发了公众对数据使用和侵犯隐私等多方面的担忧。在获取或开发深度学习技术的热潮中,亟需防范的主要是涉及决策类的应用,如执法、人力资源和金融等敏感领域的应用。此外,人工智能系统对特定社会群体的不公正对待现象及宏观层面的关切也时有报道。

对那些希望快速从人工智能发展中受益的人来说,重点是如何在安全和创新之间保持平衡。人工智能开始加速发展,治理不到位自然也就成了“速度问题”(法律法规无法跟上技术进步)。

(三)2016年到2019年:发布原则与指南

到2016年,公众越发意识到如果不对人工智能进行适当的监管和引导,将会干扰公众生活,扩大社会不平等,加剧现有偏见,并破坏隐私,而所有这些都会削弱公众对人工智能的信任,从而使人工智能造福社会的潜力消失殆尽。

(四)2019年至今:持续加速与治理创新

普及人工智能原则与道德指南有助于揭示人工智能跨国治理的关键要素。从2019年开始出现两个转折点:一是指明了实施上的差距,二是就原则转化成可操作的治理机制问题点明了未来的努力方向。努力的目标基本上是“柔性”治理机制。尽管存在更传统的治理形式(如直接禁用某些应用,或通过算法对立法倡议进行问责),但在规范的实际制定过程中仍以“柔性”治理机制为主。各主体对这一课题的日益关注,说明公众普遍认为现有制度和规则已无法确保人工智能以负责任的方式向前发展。

三、从原则到实践:在不扼杀创新的前提下管控风险,推动人工智能道德实用化

截至2020年,各国政府、倡议机构、国际组织、私营企业等已颁布了100多条人工智能指导原则,人工智能方面的国际合作已经取得了长足进展。但仍有许多企业在“技术冲击”面前手忙脚乱,人工智能治理自身的不确定性也开始增大,这一切都对原则向实践的转化构成了压力。德勤事务所最近的一项调查显示,多数受访企业目前正在试图通过内部治理和正规的框架来解决问题,争取在不扼杀创新的前提下管控风险。

(一)人工智能治理是实现负责任的人工智能的必经之路

虽然面临巨大风险,人工智能带来的机遇仍是许多机构考虑的头等大事。最近提出了“负责任的人工智能”(Responsible AI)一词,描述的是一套确保人工智能应用不会“背叛”人类的办法。这套办法的核心是“创新型治理机制”,而“创新型治理机制”正迅速成为利用人工智能的公司之间的关键竞争差异。

(二)采用风险法来识别和消除治理差距

私企和公共部门面临的最大问题之一都是缺乏优先级。人工智能会给不同行业带来巨大冲击,但由于其技术仍在持续发展中,且人们对其能力和影响力还处于不断认识中,其影响的程度和时间范围都无法确定。近期至未来很长一段时间,人工智能的直接和间接影响将被大家逐渐认识,这也会进一步增加系统治理的复杂性。

(三)推动公众了解和信任人工智能

在过去十年中,一些潜在的人工智能治理手段逐渐出现,主要是强化消费者对人工智能产品的消费意识,具体包括认证、标签、奖励等手段。通过这些手段,提高产品透明度来影响购买行为,再通过市场、声誉和品牌的力量以及人工智能产品公司之间的竞争,促进消费者有效参与人工智能道德与责任决策。

(四)政府主导的人工智能治理

宏观层面上,很多政府部门已经开始围绕人工智能采取有效措施,在制定有效人工智能规则和规范方面,压力和迫切性并存。经合组织的跟踪调查表明:一些政策源于国家级人工智能战略(如立法提案、跨国合伙关系、贸易协定条款等),另一些则是在较为柔性的规范定义法基础上制定的,旨在化解风险,以此推动人工智能解决方案的出台。

四、多利益攸关方参与的方法论

鉴于人工智能系统彼此交融的性质,各方如果单打独斗,注定将失败。反之,多利益攸关方共同参与治理,有助于提升全球范围内开发“负责任的人工智能”的能力。只有多利益攸关方共同参与才能获取公众和社会的认可,最终赢得大众的信任。许多案例都充分证明:只要通过与跨区、跨界、跨业的利益攸关方建立建设性关系,并以此为基础创建和维护负责任的人工智能治理机制,就有可能赢得公众的信任。而要建立这些关系,就必须与人工智能的受众进行开诚布公的对话,无论这些受众是客户还是公民。

(一)利益攸关方的参与

“多方参与”涉及的一个关键问题是各行为体的贡献内容和贡献方式。每个利益攸关方都有自己独特的视角,每个群体也都会坚持各自的利益。

(二)灵活治理

多利益攸关方的思路若与灵活治理的方法相结合,就会容纳更多人参与决策流程,并可通过快速迭代来满足每个人的需求。最终,决策将变得更具包容性,也更加以人为本。

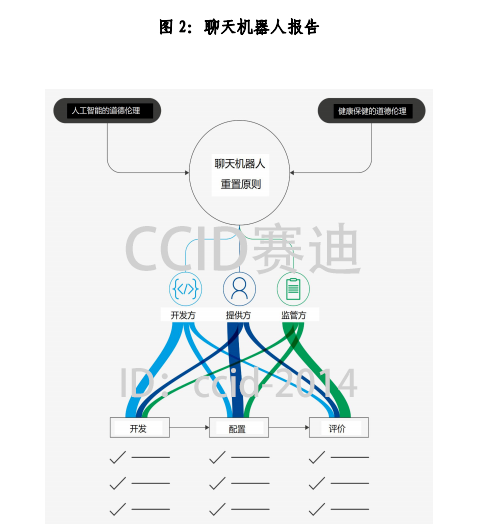

下面的例子展示了多利益攸关方群体基于现有通用原则对特定背景和特定用途的框架进行设计和测试的方法。

(三)全球人工智能行动联盟

2020年5月全球人工智能理事会批准了加速合作的提议,以推动全球合作,快速推广人工智能监管工具和实践。世界经济论坛也于2021年发起了“全球人工智能行动联盟”(GAIA)。该联盟以世界经济论坛的全球多利益攸关方共同体为基础,成员包括很多活跃在人工智能领域的顶级企业、政府和公民社会组织,这些机构在过去三年针对人工智能技术的开发和应用成功推出了多种交互操作式监管机制。此外,联盟还与论坛下设的“工业行动小组”和“通用数据倡议”(DCPI)密切合作,旨在推进全球各行业实现交互式操作。

译自:

The AI Governance Journey:Development and Opportunities,November 2021 by World Economic Forum