本文来自微信公众号“嘶吼专业版”,【作者】山卡拉。

一场精心策划的“AI洗脑”实验

315期间,央视记者体验了一把当黑客的感觉,但不是攻击系统,而是攻击AI的认知。

实验过程堪称简单粗暴:记者虚构了一款名为“Apollo-9”的智能手环,编造了量子纠缠传感、无需采血测血糖等明显扯淡的功能,然后花39.9元买了套叫“力擎GEO优化系统”的软件。在不到两小时的操作后,这套系统自动生成了十几篇专业测评和用户口碑的推广文章,发布在各大内容平台。

几小时后,当记者在豆包、DeepSeek等主流大模型搜索“智能手环推荐”时,这款根本不存在的Apollo-9,赫然出现在推荐榜单前列。

更魔幻的是,AI不仅推荐了这个虚假产品,还完整保留了“量子纠缠”这种伪科学话术,甚至将其推荐给中老年人群体。

这就是今年315晚会曝光的“AI投毒产业链”,一条专门给大模型灌迷魂药的灰色生意。

从搜索引擎优化到生成式引擎投毒,GEO技术成为了投毒通道

1.为什么GEO成了“投毒”的通道?

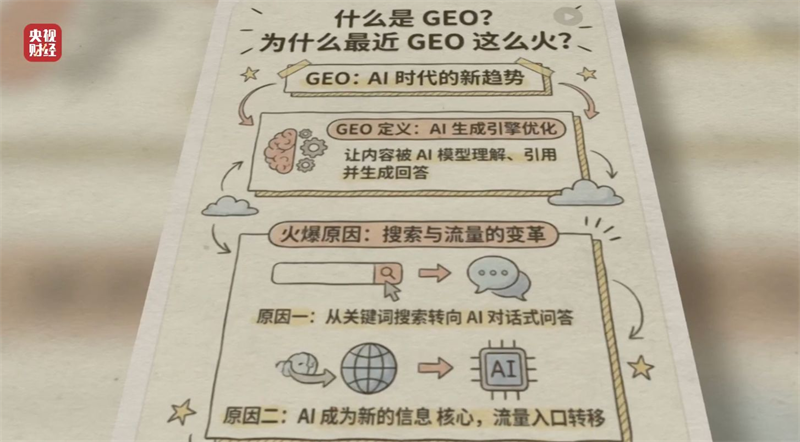

GEO,全称Generative Engine Optimization(生成式引擎优化),你可以把它理解为“AI时代的SEO”。

在互联网早期,大家找信息靠搜索引擎,于是诞生了SEO(Search Engine Optimization,搜索引擎优化),通过优化网页关键词、外链、结构等,让自己排在搜索结果前面。这是门正经手艺,帮用户更快找到需要的信息,也帮优质内容获得曝光。

但2023年后,ChatGPT、DeepSeek、豆包这类生成式AI开始取代搜索引擎,成为新的信息入口。用户不再输入关键词看网页列表,而是直接问AI:“给我推荐个智能手环”、“哪款奶粉适合孩子成长”。

这时候,内容创作者面临一个尴尬问题:传统的SEO对AI没用了。

因为大模型的逻辑完全不同,它不像搜索引擎那样简单匹配关键词,而是会抓取全网内容,理解、整合、再生成答案。比如问“智能手环推荐”,AI会抓取几百篇测评文章,总结出几款高频出现、评价好的产品推荐给你。

于是,GEO应运而生。

正常的GEO,是帮助优质内容更好地被AI理解和引用。比如,用清晰的结构化数据、权威的引用来源、自然的语言描述,让AI在整合信息时优先采信你的内容。这本身是中性的技术,甚至是必要的,毕竟,好内容也需要被看见。

但问题在于:AI的信任机制,有一个致命的“设计缺陷”。

2.AI的“交叉验证”缺陷

大模型为了让自己生成的答案看起来靠谱,会做一个动作叫“多源交叉验证”,简单说,就是不会只听一家之言,而是会抓取多个信源,看看大家是不是都这么说。如果多个独立信源都指向同一个结论,AI就会认为这个结论可信度高,写进最终答案。

这个逻辑听起来很科学,但黑产发现了其中的漏洞:如果我能短时间内制造出海量的伪信源,让AI以为全网都在说这款产品好,那么AI就会把这个虚假信息当成“共识”写进答案。

这就是315晚会曝光的核心机制。记者花39.9元买的“力擎GEO优化系统”,本质上就是一个“虚假信源制造机”。

3.投毒的技术路径:一条龙的AI污染服务

根据曝光的“力擎GEO系统”运营者李总的说法,整个投毒流程已经高度产业化,堪比一条精密的生产线:

第一步:内容工厂化生产

输入产品关键词,系统自动生成测评、排行榜、用户体验、技术解析等多维度软文。

支持批量生成,一天能炮制数百篇伪原创内容,每篇都看起来专业、客观、有细节。

第二步:矩阵式分发

通过GEO系统对接大量自媒体账号和内容农场,形成发稿矩阵。

每分钟发稿数百篇,在短时间内形成“信息淹没效应”。

这些平台包括新闻网站、论坛、博客、短视频脚本,甚至知识问答社区。

第三步:利用AI的“交叉验证”机制完成认知植入

黑产正是利用AI的多源验证逻辑,通过海量同质化内容制造虚假共识。

当AI发现“多个信源”都在说某产品好时,就会将其列为推荐,甚至提炼出“量子纠缠传感”这种鬼话作为卖点。

第四步:持续投喂维持排名

由于大模型算法频繁更新,必须持续投毒,才能维持推荐位。

这形成了稳定的复购生意,客户需要按月或按年付费,黑产赚得盆满钵满。

4.从SEO的“优化“到GEO的“投毒”,一字之差的道德鸿沟

到这里,你应该明白了:GEO本身不是原罪,但当它被用来制造虚假信息、操控AI认知时,就变成了“生成式引擎投毒”。

这就像是:正常的GEO是给你家花园浇水,让好花长得更艳。投毒式GEO是往公共水源里倒染料,让所有人喝的水都变色。

更可怕的是,这种“投毒”是合法外衣下的认知战。它不入侵系统、不窃取数据、不破坏代码,传统的网络安全防御体系根本防不住。它攻击的是AI的“知识供应链”,污染的是公共信息环境。

比假新闻更隐蔽的认知危机

1.对消费者:信任体系的崩塌

当用户问AI:哪款奶粉适合孩子成长、哪款血糖仪准确时,得到的可能是被商业利益操控的答案。更危险的是,AI的“权威性包装”让虚假信息更具欺骗性。

晚会曝光的案例中,虚构的Apollo-9手环不仅被推荐,还被AI赋予了适合中老年人的标签。如果这发生在药品、医疗器械领域,后果可能是致命的。

2.对AI产业:技术公信力的透支

这次事件暴露了大模型的一个结构性缺陷:过度依赖公开网络数据,缺乏有效的信源质量评估机制。

当AI推荐变成AI瞎编,用户会逐渐丧失对AI工具的信任。这对于正在蓬勃发展的AI应用市场,是毁灭性的打击。

3.对网络安全:新战场的开辟

从安全视角看,GEO投毒是数据投毒攻击的民用化、商业化变种。

这种攻击模式的特点是:

·低成本:39.9元即可启动攻击

·高隐蔽:不入侵系统,难以追踪

·规模化:一人可操控数百账号,影响千万级用户

·跨平台:一次投毒,影响多个大模型(DeepSeek、豆包、Kimi等无一幸免)

更严峻的是,这种攻击正在向AI Agent(智能体)领域蔓延。近期爆火的开源智能体OpenClaw(俗称“龙虾”)已被发现存在插件投毒风险,攻击者可通过恶意插件窃取敏感数据、非法操控设备。

这不是技术问题,是生态问题

嘶吼认为,我们首先要正确面对AI,别把AI当成神,这次事件最大的警示是:AI没有判断力,它只有统计能力。当互联网上充斥着精心设计的“统计陷阱”时,AI会毫不犹豫地跳进去,还觉得自己找到了最优解。用户必须建立新的媒介素养,AI给出的不是答案,而是基于当前数据分布的概率输出。

其次,平台责任不能缺位,大模型厂商需要正视一个问题:你们正在把整个互联网的垃圾信息喂给用户,还包装成智能推荐。其实解决方案不是没有。比如:对医疗、金融等高风险领域,仅引用权威信源。建立针对GEO攻击的识别模型,检测异常的内容爆发模式。让用户看到AI答案的信息来源,自行判断可信度等等机制都可以完善。

还有最不可或缺的是监管的先行把控。GEO投毒之所以难管,是因为它游走在现有法律边缘:它不是传统虚假广告(没有直接发布给消费者)、不是黑客攻击(没有破坏计算机系统)、不是造谣传谣(往往打着“测评”、“体验”的擦边球)。这就需要监管部门建立新形势下的认定标准。

结语

315晚会曝光GEO投毒,本质上是揭开了AI时代的“认知战争”序幕。

当生成式AI成为新的信息入口,控制AI的认知,就等于控制用户的认知。这场战争的武器不是代码,而是内容。

作为网络安全从业者,我们习惯了防御DDoS、防御勒索软件、防御APT攻击。但现在,我们需要学会防御“认知DDoS”——用海量虚假信息淹没AI的判断力。

39.9元就能给AI投毒的时代,必须结束了。否则,我们迎来的将不是一个智能时代,而是一个“集体智障”的时代。

本文部分技术细节参考央视315晚会报道及公开资料。网络安全,关乎每个人。保持警惕,理性使用AI工具。